对人工智能行业的一些人来说,最终的成就是创造一个具有人工通用智能(AGI)的系统,或理解和学习人类所能完成的任何任务的能力。长期以来,AGI被归入科幻小说的范畴,有人认为AGI将带来具有推理、计划、学习、代表知识和用自然语言交流能力的系统。

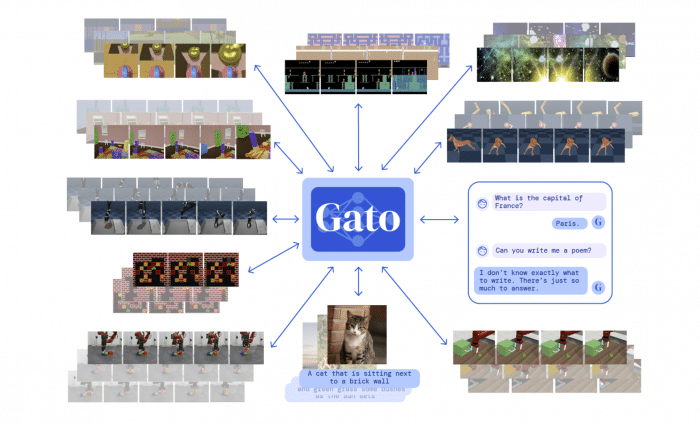

不是每个专家都相信AGI是一个现实的目标,甚至是可能的目标。由Alphabet支持的研究实验室DeepMind本周发布了一个名为Gato的人工智能系统,为实现这一目标做出了贡献。Gato是DeepMind描述的”通用”系统,一个可以被教导执行许多不同类型任务的系统。DeepMind研究人员训练Gato完成了604项任务,确切地说,包括给图像加标题,进行对话,用真正的机器人手臂堆积积木,以及玩雅达利游戏。

艾伦人工智能研究所的研究科学家Jack Hessel指出,一个能够解决许多任务的人工智能系统并不新鲜。例如,Google最近开始在Google搜索中使用一个名为多任务统一模型的系统,或称MUM,它可以处理文本、图像和视频,以执行从寻找单词拼写的跨语言变化到将搜索查询与图像联系起来的任务。像所有的人工智能系统一样,Gato通过实例学习,以标记的形式摄取了数十亿字、来自真实世界和模拟环境的图像、按下的按钮、关节扭力等等。这些标记以Gato能够理解的方式表示数据,使系统能够找出《突围》的机械原理,或者在一个句子中哪个词的组合可能具有语法意义。

Gato不一定能很好地完成这些任务。例如,在与人聊天时,系统经常以肤浅或与事实不符的回答来回应。例如,在回答法国的首都是什么时说”马赛”,在给图片加标题时,Gato给人加错了性别。而且该系统在使用现实世界的机器人时,只有60%的时间能正确地堆放积木。但在上述604项任务中的450项,DeepMind声称,Gato在一半以上的时间里表现得比专家好。奇怪的是,从架构的角度来看,Gato与当今生产中的许多人工智能系统并没有明显的不同。它与OpenAI的GPT-3有共同的特点,即它是一个”变形器”。追溯到2017年,Transformer已经成为复杂推理任务的首选架构,在总结文件、生成音乐、对图像中的物体进行分类和分析蛋白质序列方面表现出了良好的能力。

也许更值得注意的是,就参数数量而言,Gato比包括GPT-3在内的单任务系统要小几个数量级。参数是系统从训练数据中学到的部分,基本上定义了系统在某个问题上的技能,如生成文本。Gato只有12亿个,而GPT-3有超过1700亿个。DeepMind的研究人员特意将Gato保持得很小,以便该系统能够实时处理具体问题。